尋夢新聞LINE@每日推播熱門推薦文章,趣聞不漏接❤️

來源:cnet,新智元等

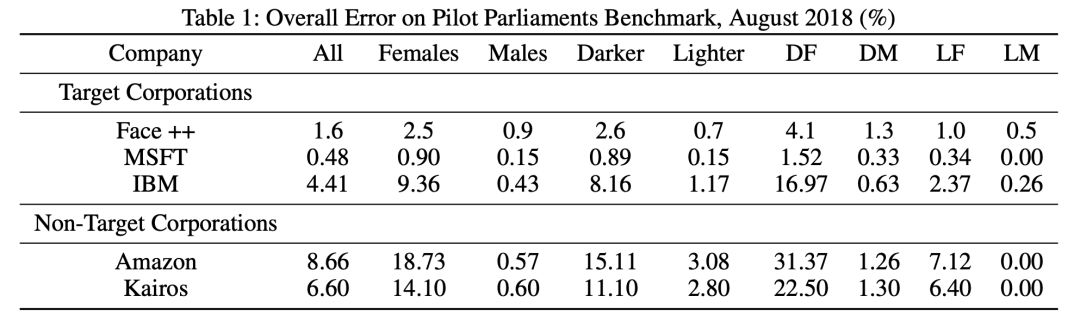

MIT的研究表明,亞馬遜與其它友商在人臉識別技術相比,誤識率較高,將黑皮膚女性識別成男性的概率高達31%。而亞馬遜方面回應稱,他們所採用的是人臉分析,而非人臉識別,其最新Rekognition產品的準確率很高。

根據MIT公布的一項研究表明,與微軟和IBM的人臉識別技術相比,亞馬遜在識別深色皮膚女性的性別方面較弱,且識別整體性別時也更容易出錯。

論文地址:

http://www.aies-conference.com/wp-content/uploads/2019/01/AIES-19_paper_223.pdf

根據這項研究,亞馬遜的Rekognition軟件把女性識別為男性的概率為19%,將黑皮膚女性識別成男性的概率為31%,相比之下,微軟只有1.5%的概率。

亞馬遜辯稱是人臉分析,而不是人臉識別,作者深表懷疑

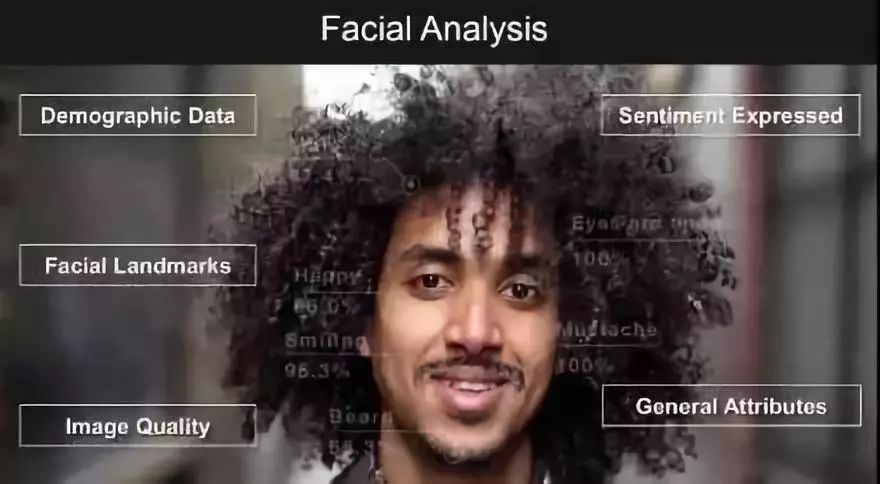

AWS人工智能總經理Matt Wood表示,該研究的測試結果是基於人臉分析(facial analysis),而不是人臉識別。

他說,分析可以在視頻或圖像中找到人臉,並賦予其一般性屬性,比如佩戴眼鏡。而識別是將人臉與視頻和照片中的圖像相匹配。 Rekognition技術包括這兩種功能。

Wood在一份聲明中說:「基於臉部分析得出的結果,我們不可能對任何用例的臉部識別準確性做出結論。」

Wood補充說:「該研究沒有使用最新版本的Rekognition。而在使用最新版本的該軟件和相似數據的情況下並沒有發現誤報。」

這項研究的兩位作者Deborah Raji和Joy Buolamwini表示,她們了解臉部識別和臉部分析之間的區別。

Raji說:「我們在論文中明確指出,我們選擇評估的任務是二元性別分類的臉部分析任務。這就意味著,在給定一定數量需要被測的人臉時,模型對它所看到的內容能夠理解多少。」

Buolamwini提醒人們,當公司說他們有完全準確的系統時,需要保持一個懷疑態度。

Buolamwini寫道:「Wood的公司使用了超過100萬張臉作為基準來測試他們的臉部識別能力,並且表現良好。雖然他們在這一基準上的表現似乎值得稱讚,但我們不知道這一基準的詳細數據或表型(皮膚類型)組成。沒有這些信息,我們就無法評估種族、性別、膚色或其他類型的誤差。」

「濫用」低準確率的人臉識別,後果不堪設想

盡管公民自由組織、國會議員和亞馬遜自己的員工都提出對隱私問題的擔憂,但亞馬遜還是向執法機構提供了Rekognition。本月早些時候,一群股東還呼籲亞馬遜停止向政府機構出售其識別技術。

根據MIT的研究,Buolamwini說亞馬遜繼續向執法機構出售技術是「不負責任的」。她說,臉部分析技術可能會被濫用,並且應用到許多場景中,造成大規模的監控。此外,其識別的不準確性可能會導致無辜的人被誤認為罪犯。

Raji也有同感。她說:「如果該系統因對特定人群的準確性降低而錯誤地識別了嫌疑人,這可能會造成嚴重的危害。」

原文鏈接:

https://www.cnet.com/news/amazons-facial-tech-shows-gender-racial-bias-mit-study-says/

論文地址:

http://www.aies-conference.com/wp-content/uploads/2019/01/AIES-19_paper_223.pdf