尋夢新聞LINE@每日推播熱門推薦文章,趣聞不漏接

Python版本 : 3.6 瀏覽器版本: Chrome

Python學習資料或者需要代碼、視頻加Python學習群:960410445

目標分析:

由於是第一個實驗性質爬蟲,我們要做的不多,我們需要做的就是:

從網上爬下特定頁碼的網頁。

對於爬下的頁面內容進行簡單的篩選分析。

找到每一篇帖子的 標題、po文人、日期、樓層、以及跳轉鏈接。

將結果保存到文本。

前期準備: 看到貼吧的url地址是不是覺得很亂?有那一大串認不得的字符?

其實這些都是中文字符, %E8%A5%BF%E9%83%A8%E4%B8%96%E7%95%8C

在編碼之後就是: 西部世界。

鏈接的末尾處:&ie=utf-8 表示該連接採用的是utf-8編碼。

windows的默認編碼是GBK,在處理這個連接的時候,需要我們在Python里手動設置一下,才能夠成功使用。

Python3相對於Python2對於編碼的支持有了很大的提升,默認全局採用utf-8編碼,所以建議還在學Python2的小夥伴趕緊投入Python3的懷抱,真的省了老大的功夫了。

接著我們翻到貼吧的第二頁: url: https://tieba.baidu.com/f?kw=%E8%A5%BF%E9%83%A8%E4%B8%96%E7%95%8C&ie=utf-8&pn=50

注意到沒有,連接的末尾處多了一個參數&pn=50, 這里我們很容易就能猜到,這個參數的與頁碼的聯繫:

&pn=0 : 首頁

&pn=50: 第二頁

&pn=100:第三頁

&pn=50*n 第n頁

50 表示 每一頁都有50篇帖子。

這下我們就能通過簡單的url修改,達到翻頁的效果了。

chrome開發人員工具的使用:

要寫爬蟲,我們一定要會使用開發工具,說起來這個工具是給前端開發人員用的,但是我們可以通過它快速定位我們要爬取的信息,並找到相對應的規律。

按cmmand+option+I 打開chrome工具,(win可以看按F12或者手動在chrome工具欄里打開)

使用模擬點擊工具快速定位到一個單獨帖子的位置。(左上角的滑鼠箭頭圖標)

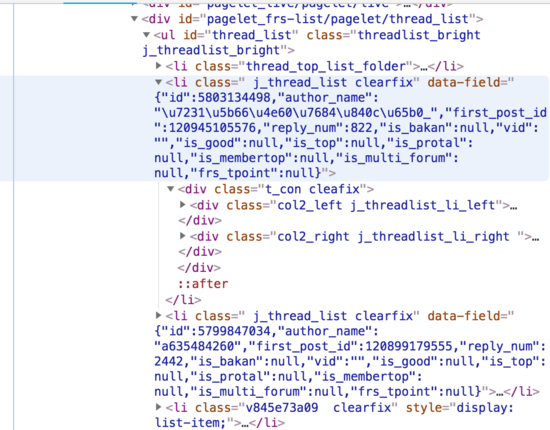

我們仔細的觀察一下,發現每個帖子的內容都包裹在一個li標籤內。

這樣我們只要快速找出所有的符合規則的標籤,在進一步分析里面的內容,最後篩選出數據就可以了。

內容分析

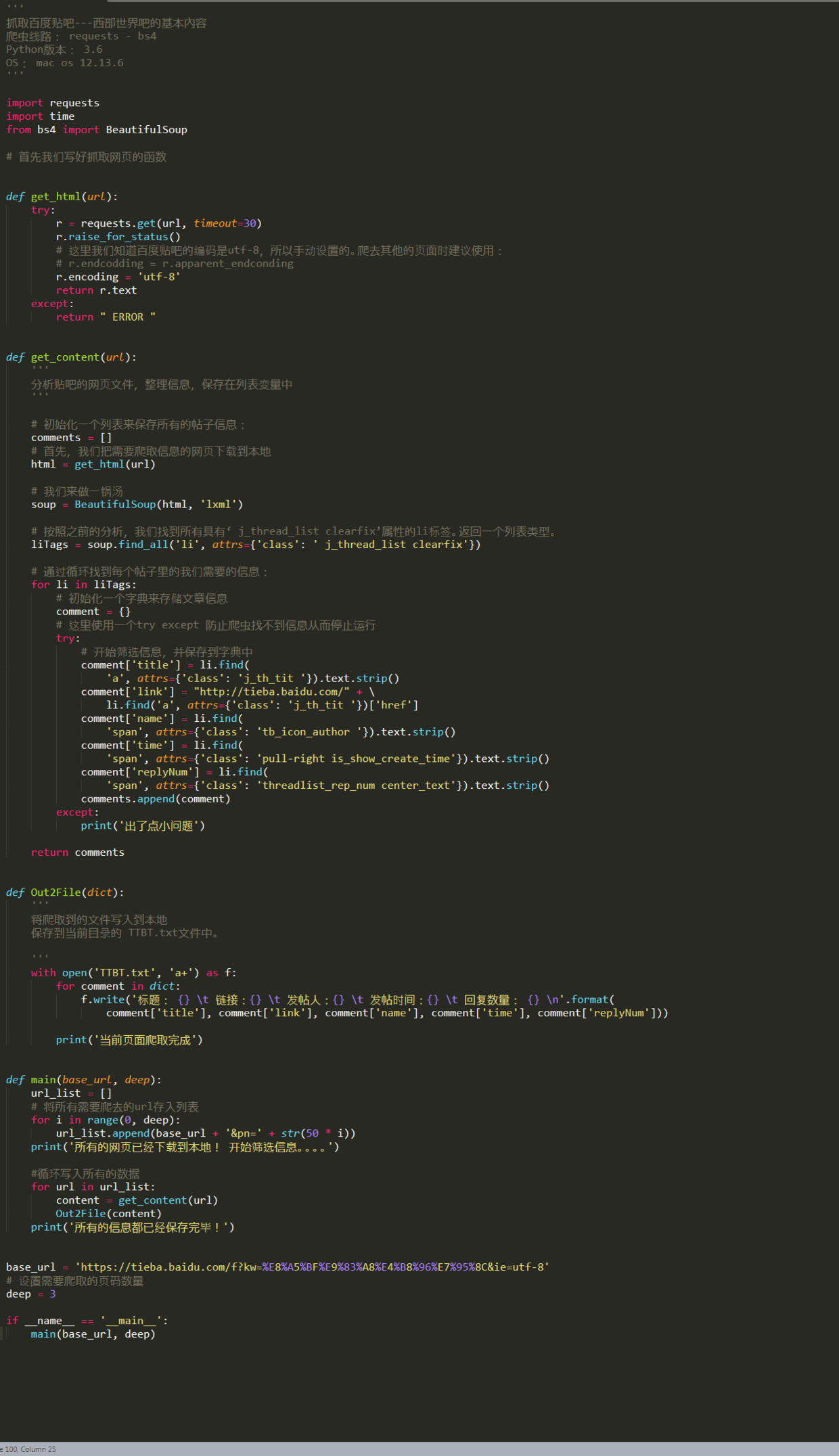

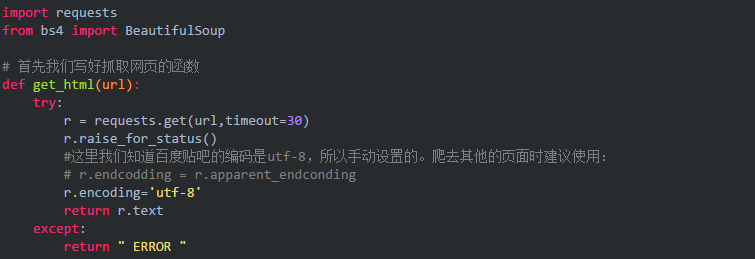

我們先寫出抓取頁面內容的函數:

這是前面介紹過的爬取框架,以後我們會經常用到。

接著我們摘取其中的詳細信息:

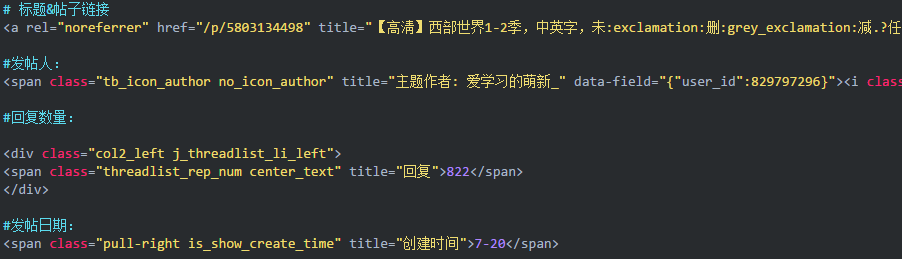

我們來分一下每一個li標籤內部的結構:一個大的li標籤內包裹著很多個 div標籤,而我們要的信息就在這一個個div標籤之內:

分析完之後,我們就能很容易的通過soup.find()方法得到我們想要的結果。

具體代碼的做到: