Kyra 杜拜巧克力現已於 全家便利商店(FamilyMart)上架販售,無論上班途中、午休甜點、下午茶搭配咖啡,都能輕鬆享受由阿聯酋直送的異國美味。品嘗一顆,就像把杜拜帶在身上。

中東奢華風味不再遙遠,現在就到全家便利商店,享受屬於沙漠之都的甜蜜誘惑。

杜拜空運來台!Kyra 杜拜巧克力正式進駐全家便利商店

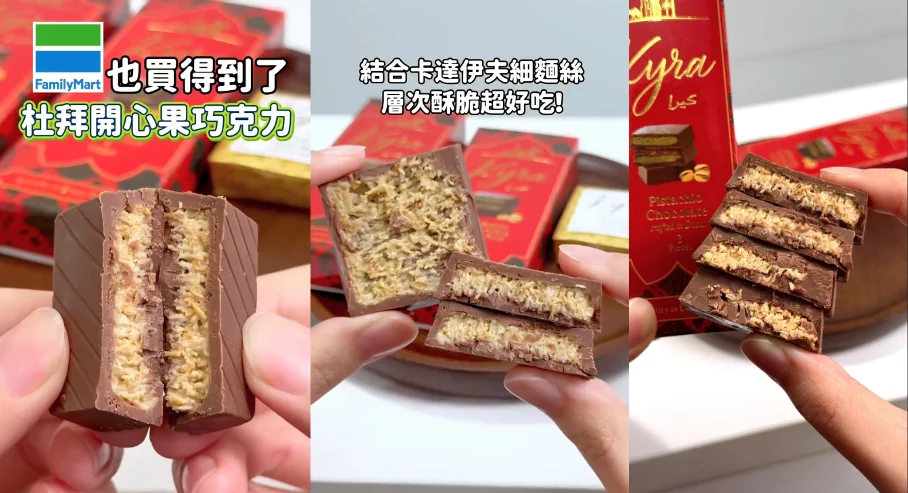

由湖瑞股份有限公司正式引進、以正規杜拜空運進口的 Kyra 杜拜巧克力,近日正式登陸全家便利商店(FamilyMart)。產品主打開心果內餡搭配中東經典 Kunafa 甜點風味,並以小包裝形式上市,瞄準台灣消費者對異國甜點的好奇心。

代理商湖瑞表示,雖然近年中東甜點風潮迅速竄紅,但市面上多數標榜「中東風味」的巧克力其實為土耳其或其他歐亞地區製造,真正「由阿拉伯聯合大公國製造、包裝,再空運出口到台灣」的產品十分稀少。

「我們希望帶給消費者真正的中東甜點體驗,而不是仿製風味。」湖瑞股份有限公司強調。此次引進的 Kyra 由杜拜工廠直送來台,從原料到包裝皆為阿聯酋製造,並融入經典中東甜點 Kunafah(庫納法)風味與開心果餡料,讓台灣消費者不用出國,就能品嘗正宗阿拉伯甜點風味。

小包裝設計貼近台灣消費習慣

針對台灣市場,Kyra 選擇推出 3 入輕量設計(60g 小份量),比常見巧克力更適合快節奏通勤族與學生作為讀書零食、辦公室與聚會的分享款,以及中東甜點入門者一次輕鬆嘗試。

輕巧袋裝更貼近便利商店購買習慣,消費者無需一次購買大盒量,就能享受異國特色甜點風味。每一小顆皆填滿餡料,擁有可可香氣、酥脆口感、開心果鹹香與 Kunafa 甜絲層次,尾韻帶堅果綿柔與濃郁奶香。

中東經典甜點 Kunafa 化身巧克力內餡

Kunafa(庫納法)是中東地區歷史悠久的甜點,多使用奶酪、奶油與酥絲麵線製作,並搭配堅果與糖漿,是阿拉伯宴會及節慶常見的經典甜食。

Kyra 將這款傳統甜點改造成巧克力餡料,融入開心果泥與奶香,並提升脆度與香氣,打造酥脆不膩口的「巧克力×中東甜點混血風味」,完美還原中東甜點傳統的奢華感。

社群話題熱度攀升 網紅搶先開箱

Kyra 杜拜巧克力剛上市即在社群間引發熱烈討論,不少美食與中東文化愛好者紛紛分享開箱心得。

Instagram 用戶 @tingjia.zhang(庭嘉 Tim)表示:「全家新品杜拜開心果巧克力,而且還是杜拜進口製造,裡面脆脆的吃了非常爽,層次豐富!」

Instagram 帳號 @missfeng2021(蹺班旅行文化觀察誌)則分享:「咬下去脆脆的口感我很喜歡耶,甜度真的是甜得很爽的超甜感。」

美食旅遊帳號 @delicacytravel(Delicacy Travel 食空旅喵)也提到:「裡面有卡達伊夫細麵絲,咬下去會有一種『喀滋』的酥脆感,讓整塊巧克力有層次。」

全家便利商店同步販售中

Kyra 杜拜巧克力現已於全家便利商店(FamilyMart)全台門市上架販售,無論上班途中、午休甜點、下午茶搭配咖啡,都能輕鬆享受由阿聯酋直送的異國美味。